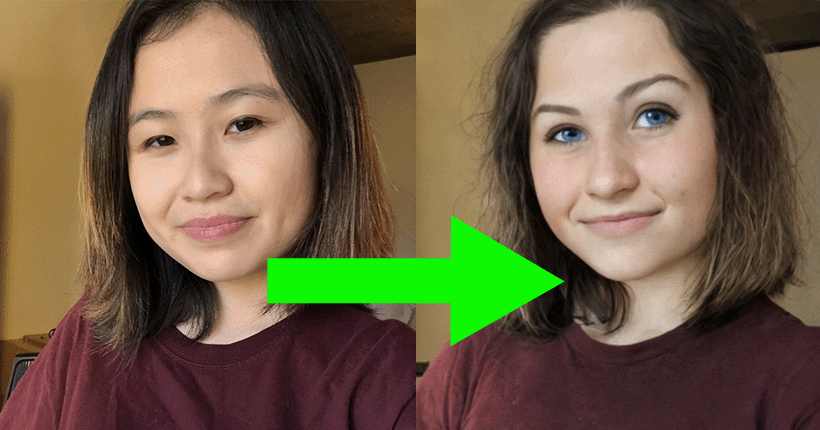

“J’essayais de me faire une photo de profil LinkedIn grâce à une IA et voilà ce que ça m’a donné”, déplore Rona Wang sur Twitter il y a quelques semaines. Rona est étudiante au prestigieux Massachusetts Institute of Technology et vient d’obtenir sa double licence en mathématiques et informatique. Elle adore tester les nouveaux modèles de langage basés sur l’intelligence artificielle ; en ce moment, son dada, c’est de les utiliser pour générer une photo de profil LinkedIn. Sauf qu’en tombant sur l’outil Playground AI, elle a eu une très mauvaise surprise, raconte le Boston Globe :

Publicité

Publicité

D’habitude, ce qui cloche chez ce genre de générateurs d’images, ce sont les doigts en trop ou les visages déformés. Mais là, ça va encore plus loin : alors qu’elle est une personne racisée, les traits de Rona ont été complètement effacés… et elle s’est retrouvée avec un “clone” à la peau blanche et les yeux bleus. “Des traits qui me donnent un air de Caucasienne”, constate-t-elle.

Le prompt, ou requête utilisée pour générer une image, demandait pourtant uniquement de transformer son selfie en “une photo de profil LinkedIn professionnelle.” Le résultat est donc complètement biaisé : “Je me disais genre ‘Wow, est-ce que ce truc pense que je devrais devenir blanche pour avoir l’air plus professionnelle ?’“, explique Rona.

Publicité

Partagée entre le rire et le choc face à une situation aussi absurde, elle tient tout de même à éviter de faire des raccourcis et d’accuser cette IA de racisme. Selon elle, plusieurs raisons peuvent avoir causé un tel dysfonctionnement. D’abord, le hasard : l’outil a peut-être généré aléatoirement le visage d’une femme blanche. Ensuite, la base de données, qui comprend peut-être une majorité d’images sur lesquelles figurent des personnes blanches.

Dans tous les cas, elle condamne un tel biais : “Je pense que c’est un problème, confie-t-elle. J’espère que les gens qui développent des logiciels sont au courant de ces biais et réfléchissent à comment les atténuer.” Surtout si des entreprises se mettent à utiliser ces outils d’IA à l’avenir pour sélectionner automatiquement le meilleur candidat le plus “professionnel”… et qu’il en ressort systématiquement une personne blanche.

Ce biais ne se limite pas à l’IA : selon un testing réalisé par la Dares, à diplôme égal, une personne d’origine maghrébine a par exemple 32 % de chances en moins d’être rappelée suite à une candidature qu’une personne blanche.

Publicité

Cette situation est un rappel des nombreux biais qui existent dans la tech, en particulier du côté de l’intelligence artificielle. Reconnaissance photo, recadrage automatique sur les réseaux sociaux, majorité de personnes blanches dans les équipes de développement, absence de représentation des personnes racisées dans les bases de données… C’est pour cela que des collectifs d’artistes se mobilisent à l’occasion d’expositions comme “In/Visible” ou “ImageNet Roulette”.

Pour se justifier, Suhail, le fondateur de Playground AI, a répondu à Rona que les modèles n’étaient “pas assez intelligents”. Avant de compléter : “Quoi qu’il en soit, nous sommes assez mécontents de cela et espérons le résoudre”.

“Il y a une culture chez certaines personnes de faire vraiment confiance à l’IA et de se reposer dessus, complète Rona au Boston Globe. Donc je pense que c’est bien que les gens y réfléchissent, surtout ceux qui pourraient penser que les biais de l’intelligence artificielle sont du passé”. C’est un phénomène à mettre à la lumière de la tendance de la “LinkedIn photo ai”, qui cumule déjà 1,6 milliard de vues sur TikTok. Le concept : fournir à Remini, une application tierce fonctionnant grâce à l’IA, une dizaine de selfies pour générer une série de photographies professionnelles de soi – en majorité à utiliser en guise de photo de profil LinkedIn.

Publicité